vim

论文阅读

sqlserver

鸿蒙

HID

测试开发

flink watermark

Tableau Desktop

PageRank

网站安全防护

渲染管线

EDM营销

校园二手交易系统

elf

PIC

粘包拆包

果蔬商城

代码质量

优化算法

go-cron

梯度下降参数不收敛

2024/4/16 9:06:52adam算法_梯度下降/批量(随机)梯度下降/动量法/RMSporp/Adam算法汇总

我们在机器学习的过程中,当我们构建好我们的模型后要对输出构建损失函数。然后要不断的减小损失函数的值来不断更新优化我们模型中的参数。那么如何优化我们的参数呢?梯度下降法:对1到M这些给出的数据计算损失函数之和的均值求导更新参数&…

loss下降auc下降_随机梯度下降法介绍及其参数讲解

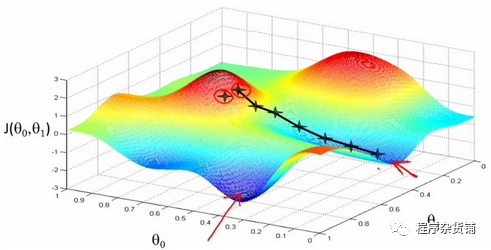

算法介绍简单来说,梯度下降就是从山顶找一条最短的路走到山脚最低的地方。但是因为选择方向的原因,我们找到的的最低点可能不是真正的最低点。如图所示,黑线标注的路线所指的方向并不是真正的地方。既然是选择一个方向下山,那么这…

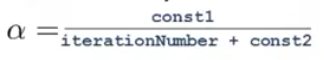

梯度下降参数不收敛_机器学习 第14集:如何判断随机梯度下降法收敛?( 含有笔记、代码、注释 )...

如何判断随机梯度下降法收敛?① 我们确定随机梯度下降法已经收敛的一个标准方法是:画出最优化的代价函数关于迭代次数的变化。② 为了检查随机梯度下降的收敛性,我们要做的是每1000次迭代运算中,计算出前一步中计算出的cost函数&a…